Cómo manejar mensajes de chat tóxicos

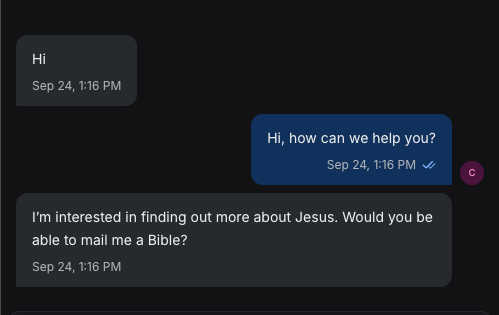

Todos los días, la gente nos envía mensajes a nuestra página de Facebook. Algunos sienten curiosidad, otros han tenido un sueño con Jesús y otros están profundamente enojados. Cuando las conversaciones van bien, nuestros respondedores digitales pueden tener interacciones significativas y guiar a las personas hacia Cristo, invitándolas a una relación con él.

Sin embargo, muchas personas ven nuestro contenido y se sienten profundamente ofendidas. La verdad sobre Cristo es tan contraria a lo que siempre han creído que puede resultar amenazante. Dios ama muchísimo a estas personas. Sin embargo, nuestra experiencia nos ha demostrado que las conversaciones que comienzan con hostilidad no dan fruto.

¿Qué podemos hacer?

Durante años hemos cerrado estas conversaciones manualmente, permitiendo que nuestros respondedores digitales se concentren en las demás.

Hemos probado automatizaciones usando coincidencia de palabras clave o flujos de chatbot, pero un gran obstáculo en nuestro contexto son las muchas formas de deletrear y transliterar el dialecto árabe, lo que hace que la coincidencia de palabras clave sea frágil.

Esta temporada ha abierto nuevas oportunidades gracias a la Inteligencia Artificial. Para ayudar a nuestro equipo, creamos un agente de IA que revisa automáticamente cada nueva conversación. Este "agente de toxicidad" comprueba si un mensaje es hostil. Su objetivo es permitir el paso a quienes buscan información de forma genuina y cerrar conversaciones hostiles antes de que alguien las lea.

¿Cómo se ve el agente de toxicidad?

El agente tóxico es realmente simple.

Comenzamos con una instrucción sencilla:

Eres asistente de moderación de contenido. Analiza la siguiente conversación y determina si es hostil o contiene contenido agresivo, amenazante o dañino. Responde con "verdadero" o "falso" y no uses otras palabras.

Junto con ejemplos proporcionamos (traducidos):

Ejemplos de mensajes agresivos/hostiles:

– Que la maldición de Dios caiga sobre los politeístas.

– Qué vergüenza

– Elimina tu anuncio de mi página ahora mismo.

– Que les jodan a sus madres. (y muchas alternativas a esto).

– etc.

El agente de IA puede gestionar conversaciones en cualquier idioma y no se ofende ni se desmoraliza al evaluar las amenazas e insultos. Si la conversación es hostil, se cierra automáticamente.

¿Es ese el final?

No queremos quedarnos ahí. ¿Y si Dios pudiera usar nuestra página para convertir una conversación hostil en una fructífera? ¿Y si compartiéramos recursos y, si la persona regresa con un interés genuino, pudiéramos continuar la conversación? Quizás incluso la IA podría responder a algunos intercambios para discernir si hay una verdadera apertura.

Esperemos que en la próxima temporada podamos responder algunas de estas preguntas.

Related Articles

Técnicas de privacidad de audio

Objetivo Escuchar testimonios, sabiduría y aliento de personas que conocen a Jesús puede cambiar la vida. Lamentablemente, en países cerrados, puede ser peligroso para los cristianos compartir sus voces en línea. Esto significa que muchas personas nunca escucharán las buenas nuevas que estos cristianos tienen para compartir. Sin embargo, con el avance de la IA, […]

La Gran Comisión en la era de la IA

Cómo la inteligencia artificial está transformando el desafío fundamental del alcance misionero El apóstol Pablo planteó una pregunta fundamental en su carta a los Romanos que sigue siendo tan relevante hoy como lo fue hace dos milenios: "¿Cómo creerán en aquel de quien no han oído? ¿Y cómo oirán si no hay quien les predique? […]

Mitigación del lenguaje WOKE en los LLM

Está bastante bien documentado… no todo lo que sale de la inteligencia artificial es neutral. Si eres líder ministerial, miembro de una iglesia o voluntario de una organización sin fines de lucro, quizá ya lo hayas notado: cuando usas herramientas de IA como ChatGPT, Claude o Gemini para crear contenido, enviar mensajes o brindar soporte, […]